2026年1月23日、ウィーン。歴史と伝統の街で、デジタル経済の未来を左右する重要なセミナーが開催されました。テーマは「AIと法律」。

生成AIの登場以降、世界は「AIゴールドラッシュ」とも呼べる熱狂の中にあります。しかし、その裏側で、倫理的な問題、著作権侵害、プライバシーリスクといった「負の側面」も急速に顕在化しています。

この状況に対し、世界で最も早く、そして最も包括的なルールを提示したのがEU(欧州連合)です。EUが定めるルールは、単なる地域規制にとどまらず、事実上のグローバルスタンダード(ブリュッセル効果)となる可能性を秘めています。日本企業にとっても、対岸の火事ではありません。

本セミナーでは、PwC Legalの最前線で活躍する二人の専門家、Dr. Stefan Winklbauer氏とMag. Konstantin Maetz氏が登壇。成立したばかりの「EU AI法(AI Act)」と、IoT時代のデータ流通ルールを定めた「EUデータ法(Data Act)」について、その核心と企業が取るべき具体的なアクションを語り尽くしました。

本稿では、両氏のプレゼンテーションを基に、その内容を可能な限り詳細に、かつ分かりやすく噛み砕いてレポートします。これは、来るべき「デジタル新秩序」を生き抜くための、必須の羅針盤となるはずです。

第1部:AIの暴走を止める「ガードレール」。世界初の包括的規制「EU AI法」の全貌

登壇者:Dr. Stefan Winklbauer (PwC Legal)

最初のセッションでは、ヴィンクルバウアー氏が「EU AI法」を中心に、AIを取り巻く法的課題の全体像を解説しました。彼はまず、AI技術の基礎――機械学習、ニューラルネットワーク、ディープラーニング、そして現在の生成AIに至る進化の歴史――を振り返り、AIがもたらす莫大な「機会」と、それと表裏一体の「リスク」を確認することから始めました。

ハルシネーション(AIがもっともらしい嘘をつく現象)、アルゴリズムによる差別やバイアス、ディープフェイクによる世論操作、そしてプライバシー侵害。これらのリスクを放置すれば、AIに対する社会の信頼は失墜してしまいます。

「AI法は、イノベーションを阻害するためのものではなく、人間中心の信頼できるAI(Trustworthy AI)を実現するための『ガードレール』なのです」とヴィンクルバウアー氏は強調します。

1. 核心は「リスクベースアプローチ」:AIを4つのレベルに分類

EU AI法の最大の特徴は、すべてのAIを一律に規制するのではなく、そのAIが人々の安全や基本的権利に与える「リスクの大きさ」に応じて分類し、メリハリのある規制を行う「リスクベースアプローチ」を採用している点です。

① 禁止されるAI(Unacceptable Risk):絶対に許されない領域

EUが「欧州の価値観と相容れない」と判断したAIシステムは、原則として開発・上市・利用が禁止されます。

- サブリミナルな操作: 人間の意識下に働きかけ、自由な意思決定を歪めるAI。

- 社会的スコアリング: 中国の信用スコアのように、個人の行動や特性に基づいて公的機関が市民を格付けするシステム。

- リアルタイム遠隔生体認証: 警察が公共の場で顔認証カメラを使って特定の人物をリアルタイムで追跡すること(テロ対策など、厳格な条件下での例外を除く)。

- 感情認識AI: 職場や学校で、AIが人々の感情を推測・評価すること(安全性や医療目的を除く)。

② 高リスクAI(High Risk):厳格な管理が求められる領域

ここが企業にとって最も影響が大きい部分です。人々の生活や権利に重大な影響を与える可能性のあるAIは「高リスク」と分類され、市場に出す前に厳格な要件を満たす必要があります。

対象となるAIの例(附属書III):

- 重要インフラ: 水道、ガス、電気などの管理システム。

- 教育・職業訓練: 入学試験の採点や、学習者の評価に使うAI。

- 雇用・人事管理: 採用時の履歴書スクリーニングや、従業員の昇進・解雇の判断を支援するAI。

- 基本的民間サービス: クレジットスコアリング(信用評価)や、生命保険・健康保険のリスク評価に使うAI。

- 法執行・司法: 犯罪予測や、再犯リスクの評価、証拠の信頼性評価などに使うAI。

高リスクAIに課される義務(プロバイダーの責任):

- リスク管理システム: 開発から廃棄までの全ライフサイクルにわたってリスクを特定・評価・軽減する仕組みの構築。

- 高品質なデータ: 学習・検証・テストに使うデータの正確性、完全性、バイアスのなさを確保する(データガバナンス)。

- 技術文書: AIの設計、動作原理、リスク評価などを詳細に記録した文書の作成。

- 記録保持(ロギング): AIの動作履歴を自動的に記録し、問題発生時に追跡できるようにする。

- 透明性と情報提供: ユーザー(導入企業など)に対し、AIの能力、限界、使用目的などを分かりやすく説明する。

- 人間による監視(Human in the Loop): AIの判断を人間が適切に監督・介入できる仕組みを組み込む。

- 正確性・頑健性・サイバーセキュリティ: 一定の性能基準を満たし、外部からの攻撃に対する耐性を持たせる。

これらの要件を満たしていることを証明するため、企業は「適合性評価」を実施し、CEマークを表示する必要があります。多くの場合、第三者機関による認証が必要です。

③ 限定的リスクAI(Limited Risk):透明性が求められる領域

人間と対話するチャットボットや、ディープフェイク(画像、動画、音声)を生成するAIなどが該当します。これらには、特定の「透明性義務」が課されます。

- 人間ではないことの明示: チャットボットは、ユーザーが「AIと話している」ことを認識できるようにしなければなりません。

- 合成コンテンツの表示: ディープフェイクやAI生成画像には、それが人工的に生成・操作されたものであることを明示する必要があります(電子的な透かしなど)。

④ 最小リスクAI(Minimal Risk):規制対象外の領域

スパムフィルターや、AIを搭載したビデオゲームなど、リスクが軽微な大多数のAIは、AI法の特別な義務の対象外です。ただし、自主的な行動規範の遵守が推奨されます。

2. 「基盤モデル(GPAI)」への特別ルール:ChatGPTなどはどうなる?

ChatGPTやStable Diffusionのような、汎用的な目的で使える強力なAIモデル(汎用AIモデル:GPAI)は、その上に様々な応用アプリケーションが作られる「基盤」となるため、特別なルールが設けられました。

- すべてのGPAIモデルの義務: 技術文書の作成、モデルの学習プロセスや能力に関する情報提供、そして「EU著作権法を遵守するためのポリシー策定」が求められます。特に著作権に関するポリシーは、学習データの透明性を高める上で重要です。

- システミックリスクを持つGPAIモデル: GPT-4のような特に高性能なモデル(計算能力が一定の閾値を超えるもの)は、社会全体にシステミックなリスク(大規模な偽情報の拡散、サイバー攻撃への悪用など)をもたらす可能性があるため、追加の厳格な義務が課されます。これには、最先端のモデル評価(レッドチーミングなど)、システミックリスクの評価・軽減措置、エネルギー消費量の報告、サイバーセキュリティの確保などが含まれます。

3. AI法だけではない! 著作権、GDPR、そして責任問題

ヴィンクルバウアー氏は、AIビジネスを行う上で考慮すべき法律はAI法だけではないと警鐘を鳴らします。

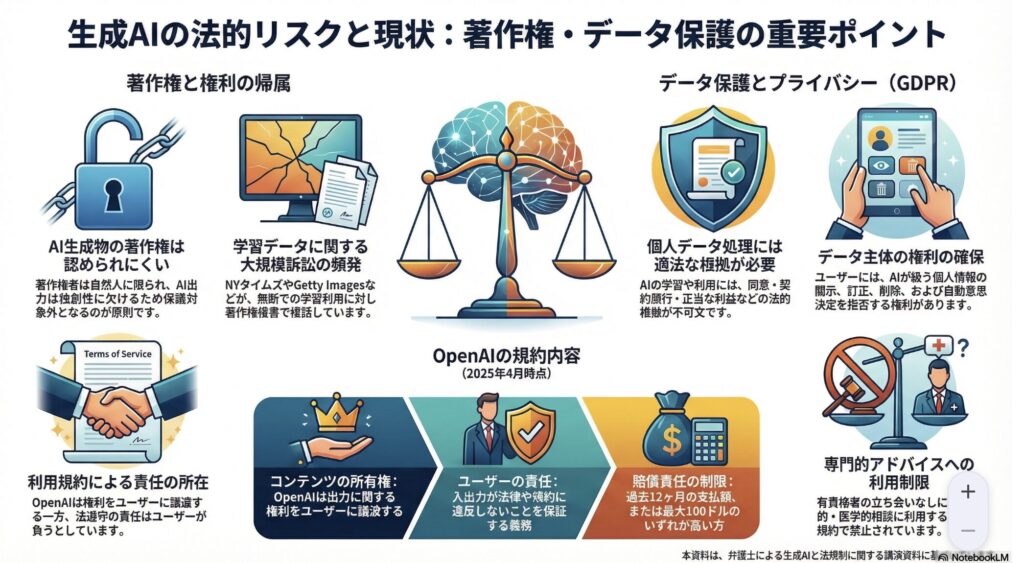

著作権:学習データと生成物のジレンマ

- 入力(学習)段階: AIの学習に他人の著作物を無断で使うことは許されるのか? EUでは、研究目的以外の「テキスト&データマイニング(TDM)」も一定条件下で適法となりますが、権利者が「機械読取り可能な形式」で利用を禁止(オプトアウト)した場合は使えません。企業は、学習データが適法に入手されたものであるか、厳密に確認する必要があります。

- 出力(生成)段階: AIが生成したコンテンツに著作権は発生するのか? 現時点では、AIが自律的に生成したものは原則として保護対象外です。人間がプロンプト(指示)を工夫したり、生成物を修正したりするなど、「創作的な寄与」があった場合にのみ保護される可能性があります。また、生成物が既存の著作物に酷似していた場合、著作権侵害となるリスクもあります。

データ保護(GDPR):個人データの壁

AIの学習に個人データを使う場合、世界で最も厳しい個人情報保護規則であるGDPRが適用されます。企業は「どのような法的根拠(同意、正当な利益など)でデータを利用するのか」「目的外利用になっていないか」「データ主体(本人)の権利(削除権など)をどう保障するか」といった難問をクリアしなければなりません。また、AIによる「完全に自動化された意思決定(プロファイリングを含む)」には、GDPRで厳しい制限がかけられています。

責任問題:AIが事故を起こしたら誰のせい?

自動運転車が事故を起こしたり、医療AIが誤診したりした場合、誰が責任を負うのでしょうか? 既存の民法(契約責任、不法行為責任)だけでは、AI特有の「ブラックボックス性」(なぜその結論に至ったかが人間には分からない)により、被害者が因果関係を証明することが困難です。 そこでEUでは、2つの新しい指令案が議論されています。

- AI責任指令案: AIが原因で損害が生じた場合、被害者の立証責任を軽減(因果関係の推定など)し、企業に情報開示を求める権利を認めるものです。

- 改正製品責任指令案: 従来の「モノ」だけでなく、AIなどのソフトウェアも「製品」の定義に含め、欠陥があった場合の製造物責任(無過失責任)を問えるようにするものです。

第1部のまとめ:企業が今すぐやるべきこと

ヴィンクルバウアー氏は最後に、企業への実践的なアドバイスで締めくくりました。

- AIインベントリの作成: 自社がどのようなAIシステムを開発・利用しているか(あるいは利用しようとしているか)を洗い出す。

- リスク分類: それぞれのAIシステムが、AI法のリスク分類のどこに該当するかを判定する(特に「高リスク」の見極めが重要)。

- ギャップ分析: 高リスクAIに該当する場合、現在の自社の体制と、AI法が求める義務との間にどのようなギャップがあるかを特定する。

- AIガバナンス体制の構築: AI倫理指針の策定、リスク管理プロセスの導入、従業員教育など、組織的な対応体制を整える。

- 契約の見直し: AIベンダーとの契約において、AI法の遵守や責任分界点について明確に定める。

AI法の適用は段階的に始まりますが、禁止されるAIは施行から6ヶ月後、GPAIのルールは12ヶ月後、高リスクAIの大部分は24ヶ月後には適用されます。準備に残された時間は決して多くありません。

第2部:データは誰のもの? IoT時代の新ルール「EUデータ法」が拓くデータ経済

登壇者:Mag. Konstantin Maetz (PwC Legal)

第2部では、メーツ氏が、IoT(モノのインターネット)時代におけるデータの取り扱いルールを定めた「EUデータ法(Data Act)」について解説しました。これは、一部の巨大テック企業によるデータの囲い込みを防ぎ、データの公平なアクセスと流通を促進することで、欧州のデータ経済を活性化させることを目的とした野心的な法律です。2025年9月12日から(一部例外あり)適用が開始されます。

1. 根本思想:「データはユーザーのもの」

データ法の核心は、非常にシンプルかつ強力です。**「コネクテッド製品(IoT機器)とその関連サービスの使用によって生成されたデータは、その製品のユーザー(所有者や借主など)がアクセスし、利用する権利を持つ」**という考え方です。

これまでは、スマート家電や産業機械が生成するデータは、事実上、メーカー(データホルダー)が独占的に管理・利用しているケースがほとんどでした。データ法は、この現状を打破しようとしています。

対象となる「製品」と「データ」

- 対象製品: インターネットに接続され、データを生成・収集・送信するあらゆる物理的な製品。スマートウォッチ、スマート家電、コネクテッドカー、産業用ロボット、スマート農業機械などが含まれます(PCやスマホなど、主にコンテンツの表示・再生に使われる機器は除外される場合があります)。

- 対象データ: 製品の使用によって意図的・受動的に生成された、生データ(raw data)および前処理されたデータ。これには、センサーデータ、動作ログ、環境データなどが含まれます。ただし、データホルダー独自のアルゴリズムで高度に加工・分析された「推論データ」は対象外となる可能性があります。

2. メーカーに課される義務:Data by Designと共有義務

データ法は、メーカー(データホルダー)に対して、製品設計の段階からデータのアクセス性を考慮することを求めています。

① 設計によるデータアクセス(Data by Design)

メーカーは、製品が生成するデータを、ユーザーが「デフォルトで、簡単に、安全に、そして可能な限りリアルタイムで」直接アクセスできるように製品を設計・製造しなければなりません。例えば、ユーザー向けのダッシュボードやAPIを用意し、ユーザーが自分のデータをいつでも確認・ダウンロードできるようにする必要があります。また、製品の購入前に、どのようなデータが生成され、どう利用されるのかをユーザーに明確に情報提供する義務も課されます。

② 第三者へのデータ共有義務

これがデータ法の最もインパクトのある部分かもしれません。ユーザーは、メーカーに対し、自分が生成したデータを「第三者」に直接共有するよう求めることができます。

この「第三者」には、修理業者、アフターサービス提供者、保険会社、競合他社などが含まれます。例えば、あるメーカーの産業機械を使っている工場が、その機械の稼働データを、メーカーとは別の独立したメンテナンス業者に共有させ、より安価で質の高い保守サービスを受けるといったことが可能になります。

これにより、メーカーによるアフターマーケットの囲い込みが崩れ、修理やサービス分野での競争が促進されることが期待されています。ただし、共有されたデータを、競合する製品の開発に直接利用することは禁止されています。

3. B2Bデータ共有のルール:公平な競争環境のために

データ共有を実効性のあるものにするため、データ法はB2Bの契約交渉におけるルールも定めています。

- FRAND条件: データホルダーは、データ共有を求められた場合、「公正、合理的、かつ非差別的(FRAND)」な条件で応じなければなりません。不当に高い対価を要求したり、特定の相手を差別したりすることは許されません。

- 中小企業の保護: データ受領者が中小企業(SME)である場合、データホルダーが請求できる対価は、データの生成・提供にかかる「実費(合理的なマージンを含む)」に限定されます。大企業が中小企業に対して不当に高いデータ利用料を吹っかけることはできなくなります。

- 不公正な契約条項の禁止: B2Bのデータ共有契約において、一方の当事者(特に中小企業)に著しく不利な「不公正な契約条項」は無効とされます。例えば、データホルダーの責任を不当に免除する条項や、相手方のデータ利用を不当に制限する条項などが該当します。

4. クラウド切り替えの円滑化:ベンダーロックインの解消

データ法は、IoTデータだけでなく、クラウドサービス市場の健全化も狙っています。企業が現在利用しているクラウドサービス(IaaS, PaaS, SaaS)から、別のプロバイダーへ乗り換えたり、オンプレミス環境へ移行したりする際の障壁(スイッチングコスト)を下げるためのルールが導入されます。

- 移行の技術的支援: クラウドプロバイダーは、顧客がデータやアプリケーションをスムーズに移行できるよう、オープンなインターフェースの提供や、互換性の確保などの技術的な支援を行わなければなりません。

- 移行手数料の撤廃: プロバイダーが顧客に請求できる「移行手数料(スイッチングフィー)」は段階的に引き下げられ、最終的には(データ法施行から3年後には)完全に撤廃されなければなりません。

- 契約解除の円滑化: 移行プロセスは最大30日(例外的に延長可能)以内に完了させる必要があり、顧客は最低2ヶ月の通知期間で契約を解除できるようになります。

第2部のまとめ:企業が今すぐやるべきこと

メーツ氏は、データ法の適用開始に向けた準備アクションとして以下を挙げました。

- 製品・サービスのマッピング: 自社が製造・販売・利用している製品が「コネクテッド製品」に該当するか、また提供しているサービスが「関連サービス」に該当するかを確認する。

- データインベントリの作成: それらの製品・サービスから「どのようなデータ」が生成・収集されているかを詳細に把握する。

- 製品設計の見直し: ユーザーがデータに簡単にアクセスできるよう、製品のUI/UXやシステムアーキテクチャを見直す(Data by Designの実装)。

- 契約書・利用規約の改訂: ユーザーへの情報提供義務を果たし、データ共有のルールを反映させるため、販売契約書、利用規約、プライバシーポリシーなどを見直す。

- データ共有プロセスの構築: ユーザーや第三者からのデータ共有請求に、FRAND条件でスムーズに対応できる社内プロセスやAPIを整備する。

全体のまとめ:規制を「コスト」ではなく「競争力」へ

約1時間にわたるセミナーで浮き彫りになったのは、EUがAIとデータという、これからの経済の「核」となる領域において、非常に強力で包括的な法的枠組みを本気で構築しようとしている姿です。

これらの規制は、一見すると企業にとって巨大なコンプライアンス負担(コスト)のように思えます。しかし、ヴィンクルバウアー氏とメーツ氏は、これを単なるコストとして捉えるべきではないと示唆しています。

明確なルールが設定されることは、予見可能性を高め、企業が安心してAIやデータビジネスに投資できる環境を生み出します。「信頼できるAI」「公平なデータ流通」というEUの掲げる価値観は、長期的には、消費者の信頼を獲得し、持続可能なビジネスを構築するための強力な武器となるはずです。

法規制への対応を、受動的な「守り」のアクションとしてではなく、自社のガバナンス体制を強化し、新たなビジネスモデルを創出するための能動的な「攻め」の機会として捉え直すこと。それが、デジタル新秩序の時代を勝ち抜く鍵となるでしょう。

【編集後記:次なる波「AIエージェント」へ】

本セミナーでは「AI規制」と「データ流通」という現在の重要課題が語られましたが、テクノロジーの進化は待ってくれません。次の波はもう目の前に来ています。それが、自律的に目標を達成しようとする「AIエージェント」です。

セミナーの最後に案内があった「AgentCon Vienna」(2026年1月29日開催)は、まさにこのAIエージェントをテーマにした開発者向けカンファレンスです。Microsoftの最新AIプラットフォームや、エージェント間の連携技術など、最先端のトピックが扱われる予定です。規制対応と並行して、こうした次のテクノロジートレンドをキャッチアップし続ける姿勢が、これからのビジネスパーソンには不可欠になるでしょう。